La próxima frontera de los ciberdelitos en la red es el uso malintencionado de la tecnología deepfake, y el reto es ya en cómo combatirlo. Podemos definir deepfakes como la generación de imágenes, vídeos y , atención con esto, audio y voz falso, generado sintéticamente a partir de muestras y ejemplos de un modelo real. Personas, animales o cosas. Esto permite colocar en situaciones y lugares interactuando y realizando acciones a personas que nunca estuvieron allí y nunca hicieron nada de lo que vemos y oímos. Aquí tienen un buen artículo de Marilín Gonzalo sobre deepfakes.

Esta generación de contenido se hace alterando el original haciendo competir a redes neuronales en las que una de ellas se encarga de ir modificando la fuente y la otra comparar el original y la copia hasta que no es capaz de identificar la verdadera. Es lo que llamamos Redes Generativas Antagónicas, o Generative Adversarial Network (GAN). El uso de algoritmos e Inteligencia Artificial, aplicado a estas redes, es lo que las hace tan potentes.

Los buenos usos de esta tecnología pueden ser tan lúdicos como el humor en forma de parodias, o la generación de documentos visuales restaurando la imagen de personas fallecidas y permitiendo que interactúen en una época en la que ya no estaban. Los malos usos van desde la desinformación, la manipulación, campañas políticas y de destrucción de la reputación de personas y gobiernos, hasta, por supuesto, el acoso a los sectores más desprotegidos de nuestra sociedad como son las mujeres.

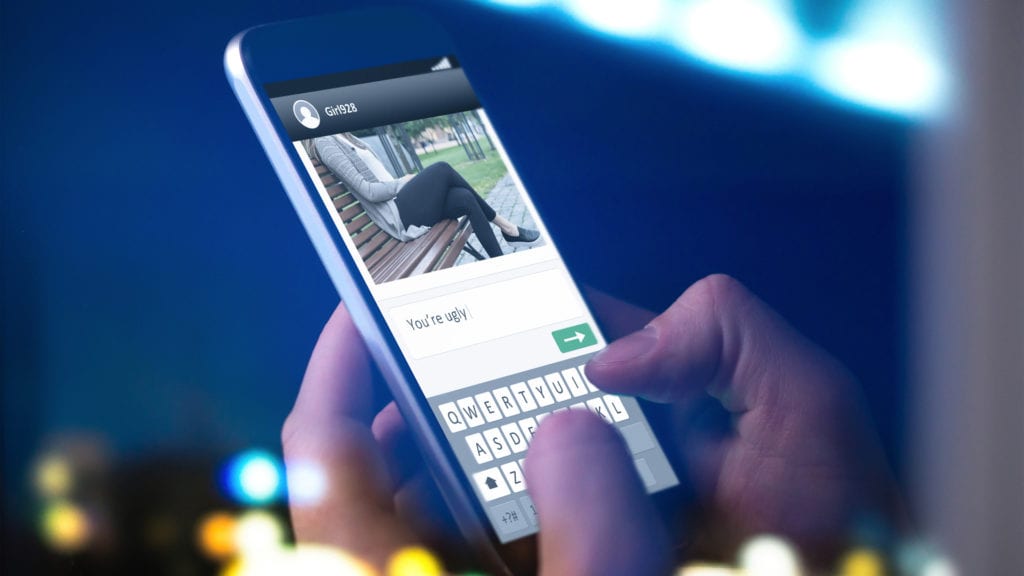

Deepfakes, violencia contra las mujeres y ciberdelincuencia

En un principio el acercamiento al uso de deepfakes por parte de los ciberdelincuentes tenía como objetivo saltar las medidas de seguridad en reconocimiento visual y de audio. Pero la cantidad de posibilidades que otorgan los contenidos generados lo ha llevado más allá. De hecho, los objetivos en el uso contra personas (como el chantaje, el robo de identidad y la ingeniería social) se han incluido al portfolio están complementando y desplazando el de uso de generar pornografía. Dentro de las actividades comerciales se han incorporado como servicios cursos y lecciones sobre procedimientos, software… Y por supuesto la generación de estos contenidos con su edición y producción.

☷

Deepfakes

Cuando la inteligencia artificial hace que ya no puedas creer a tus ojos

Los Deepfakes se empezaron a popularizar como término en 2017. Fue en Reddit, una de las comunidades más grandes de la red. Su deriva hacia el uso pornográficos y contenido NSFW llevó a la suspensión de esta comunidad original un año después. Las primeras apps creadas cambiaban el aspecto del rostro, como Fakeapp, y en uso más cuestionable, desnudaba a las mujeres, como Deepnude. Eso fue en junio de 2018.

La combinación entre ambas utilizaciones, que en un principio se dirigió contra mujeres famosas, los llevó a ampliar sus víctimas a mujeres de todo tipo, hasta que en 2019 estas apps fueron prohibidas. Por supuesto inmediatamente fueron sustituidas por otras similares que hacían lo mismo. En diciembre de 2018 se detectaron algo más de 8.000 vídeos. En noviembre de 2019 eran ya más 14.678 vídeos con estas características: deepfakes que son una forma de violencia contra las mujeres. Tenían más de 134 millones de visualizaciones.

La distribución en las redes, y su uso en mensajerías instantáneas, aumentó este problema. Después de la primera eliminación de Deepnude se detectó en Telegram una comunidad con un servicio que, previo envío de una imagen, generaba su correspondiente desnudo. 104.852 mujeres fueron víctimas hasta junio de 2020. En solo 3 meses el número pasó a ser un 198% mayor. El 20 de octubre de 2020 eran ya más de 680.000. La comunidad constaba de más de 100.000 miembros y siete canales de Telegram apoyados en la red social rusa VK. Cerca de 380 páginas promocionaban estos canales.

El panorama en 2021 no es mejor. Entre el 90 y el 95% de los vídeos generados por deepfake en estas comunidades son de actos sexuales no consentidos y su número se ha ido duplicando cada mes desde sus orígenes en 2018. Unos 84.000 aproximadamente. Incluso la promoción de estos servicios en redes como Twitter no es extraña.

Muchos de estos vídeos están relacionados con el porn revenge, porno de venganza, y la sextorsión. Es decir, en la distribución de contenidos íntimos, y falsos, por venganza contra parejas o ex parejas. Simplemente por hacer daño, o con carácter de chantaje económico. Los deepfakes son un verdadero problema que se añade a la violencia contra las mujeres.

El negocio en la DarkWeb cotiza entre los 20 y 50 dólares por la generación de este tipo de imágenes, y la confección de vídeos entre 150 y 150 dólares. Los trabajos “profesionales” cotizan hasta varios miles de dólares, y exigen una enorme cantidad de imágenes de las víctimas. Estos se reservan habitualmente para cuestiones políticas o empresariales. Sí, también se usan en esos entornos.

¿Y qué se está haciendo para combatir esto? Pues es complicado. Primero porque la concepción de la libertad de expresión en en EEUU y su primera enmienda es el argumento usado por las tecnológicas para “evitar” afrontar este problema, una vez más. Tímidos movimientos , como el de Facebook y su convocatoria a un concurso para mejorar la detección de estos vídeos en su red parecen más brindis al sol que otra cosa. La obligación de incorporar “marcas de agua” en los contenidos generados por estas herramientas ayuda, pero no es una obligación legal, si no algo más moral o ético.

Esperemos que las herramientas, como esta de Sensity, se desarrollen, permitiendo la comprobación de la veracidad de los vídeos, y contenidos. Mientras no queda más que estar atentos y combativos con estos malos usos de la red.

Si les ha interesado el tema prometo hablarles de los efectos de todo esto en la política y en los negocios.