Hemos creído que podíamos preguntarle cualquier cosa, pero no podemos pedirle veracidad. La inteligencia artificial más sofisticada en modelos de lenguaje natural, nos recuerda que la verdad no se consigue gratis. Como aquella robot que sólo miraba a los ojos de humanos, ChatGPT ha venido a seducirnos. ChatGPT es un chatbot, un robot que desde detrás de un chat puede responder todo tipo de preguntas con una elocuencia sin precedentes. Desde hace un par de semanas es el último juguete de internet.

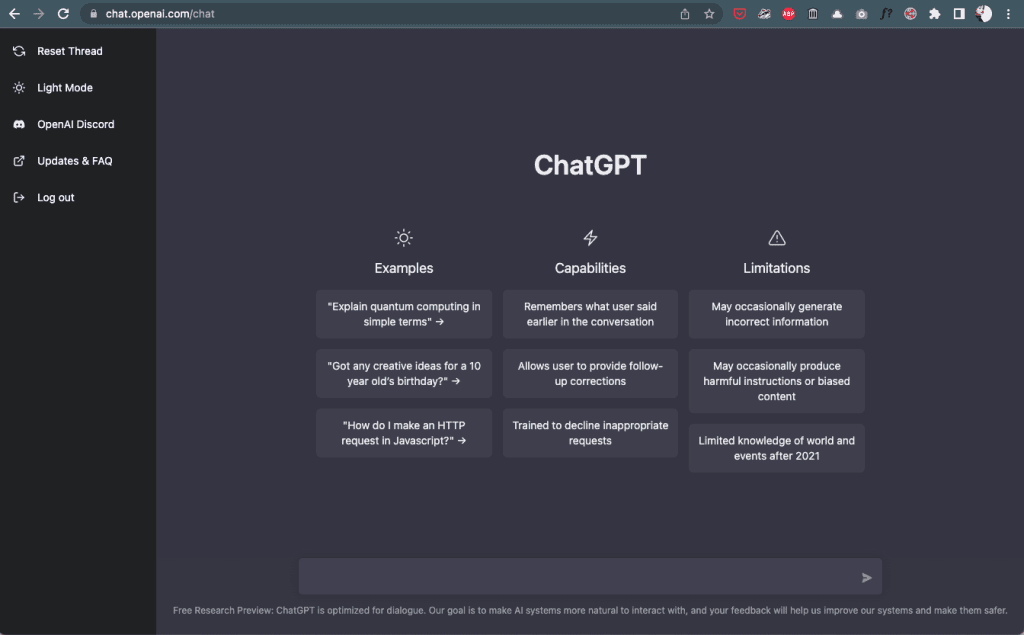

Qué es ChatGPT

ChatGPT es la versión mejorada de un modelo de inteligencia artificial llamado GPT-3, uno de los más avanzados en la actualidad, creado por OpenAI y que sorprendió cuando fue lanzado en 2020.

Estos sistemas de inteligencia artificial, llamados Large Language Models (grandes modelos de lenguaje) y basados en aprendizaje automático, pueden leer, resumir, traducir textos y predecir palabras futuras en una frase, lo que les permite generar discursos similares a cómo hablan y escriben los humanos. GPT-3 se basa en patrones obtenidos a través de grandes cantidades de textos que existen en la web, incluso conversaciones de personas.

Cómo funciona ChatGPT

¿Cómo funciona? Una vez que creas tu usuario (previa introducción de tu email y teléfono móvil), se abre un chat en el que puedes pedirle a ChatGPT que genere textos muy diversos. Puedes pegar un artículo y pedirle que lo resuma de forma que lo entienda un estudiante de primaria, y también puede desarrollar una narración o un texto dándole una serie de puntos; puedes pedirle que te explique un concepto complejo en un párrafo, que escriba la historia de Humphrey Bogart en verso, que escriba guiones con el estilo o la longitud que quieras, que haga letras de canciones, que cuente un chiste, que escriba código informático, que juegue contigo a adivinar series de televisión a partir de emojis.

El formato de diálogo hace posible que ChatGPT responda a las repreguntas, que admita sus errores (e incluso se disculpe por ellos) y que pueda rechazar pedidos que considere inapropiados. ChatGPT es un modelo hermano de InstructGPT, otra IA de OpenAI, que está entrenado para seguir instrucciones y proveer respuestas detalladas.

Este tipo de inteligencias artificiales son conocidas desde hace tiempo. Ariel Guersenzvaig, profesor e investigador en ELISAVA, investiga los impactos socio-éticos de la IA, y dice que ChatGPT no le ha planteado nuevas preguntas. “Funciona mejor que otros sistemas que he probado anteriormente y en ese sentido no es algo totalmente novedoso, es una interación brutal de cosas que ya se conocían. Lo que sí me sorprendió es el hype (entusiasmo) de un montón de gente que se ha metido a probarlo; gente que normalmente no habla de estos temas, ahora lo hace”, señala.

Elocuente y popular

Lo que hace a ChatGPT diferente de otros sistemas son fundamentalmente dos aspectos: por un lado, ha incorporado ajustes que la hacen más conversacional y por lo tanto, más “humana”. Ha sido optimizada para el diálogo usando un método que llaman Aprendizaje Reforzado con Respuesta Humana (RLHF por sus siglas en inglés), que utiliza respuestas humanas para guiar al modelo hacia los comportamientos esperados.

Es la primera vez que una herramienta tan sofisticada como esta es accesible por cualquier persona, gratuitamente y con una interfaz familiar, en varios idiomas que en los que contesta con coherencia.

Su formato ha sido clave: alcanzó un millón de suscriptores en los primeros 5 días. Las redes se han llenado de capturas de pantallas de textos de los usuarios que la están probando. Y esto está relacionado con el segundo aspecto.

El campo de personas que está accediendo a la interacción con este tipo de inteligencia artificial se ha ampliado con ChatGPT. “Tenemos aquí algo que se nos presenta en una interfaz familiar, esto hace que le apliques un modelo mental similar al que usas con otros agentes -humanos- con los que interactúas”, ha explicado Jacob Andreas, profesor de IA y lenguaje dell MIT en Wired.

Limitaciones y sesgos de ChatGPT

Como ya hemos contado en Newtral, los riesgos de las inteligencias artificiales siempre caen hacia el lado de los sesgos. Un robot que se entrena con cantidades masivas de textos producidos por humanos tiende a multiplicar los sesgos sexistas o racistas con los que fue alimentado, y este es un gran problema de los algoritmos de caja oscura actualmente.

Probablemente para evitar problemas, sus creadores la han limitado en varios sentidos. ChatGPT no hace búsquedas en la web para tener información de acontecimientos recientes, no resuelve cuestiones de actualidad y sus conocimientos llegan hasta un corte de tiempo específico, el año 2021.

Tampoco contesta a ciertos requerimientos por una cuestión de principios, y OpenAI la ha programado para rechazar “peticiones inapropiadas”. La experimentación a gran escala que está haciendo OpenAI con millones de usuarios entrenando a la máquina en estos momentos probablemente sea una de las causas por las que la ha puesto a disposición pública gratuita por el momento. De esta manera puede detectar más rápido los fallos de la herramienta y detectar los posibles usos nocivos de ChatGPT.

Un generador de clichés

Aunque parezca que lo hace, ChatGPT no razona. No tiene la habilidad de entender verdaderamente la complejidad del lenguaje humano. Está entrenada simplemente para generar palabras que se basan en patrones estadísticos, por lo que concuerdan en sentido y gramática, pero no tiene la capacidad de comprender el significado de esas palabras. David Karpf, investigador en la Universidad George Washington la ha llamado un “generador de clichés”.

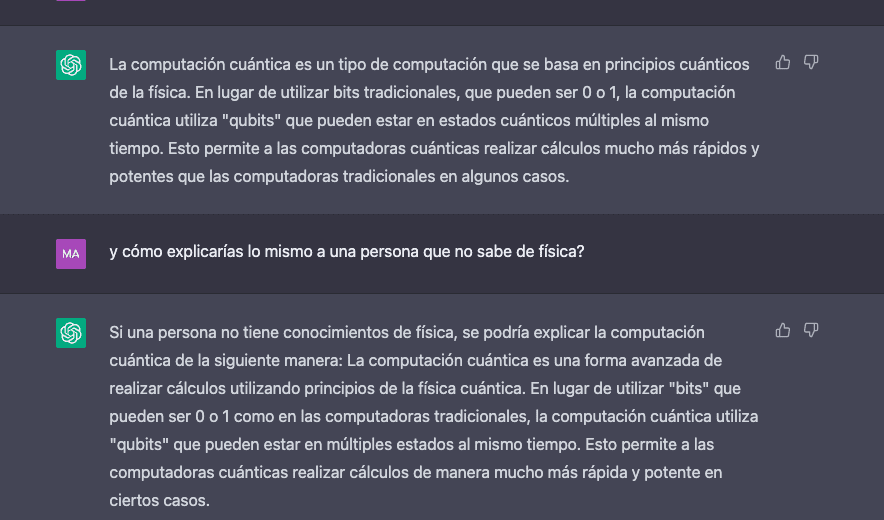

En cierto sentido, ChatGPT está programada para ser conversacional, no para ser veraz, y hace muy bien lo primero. Los usuarios han encontrado rápidamente varios casos en los que ChatGPT inventa hechos, personas, datos, y los mezcla en textos muy bien redactados y convincentes. Guersenzvaig dice que “se inventa fuentes, se inventa personas que no existen, les atribuye libros que no han escrito y si le pides que cite, lo hace con textos que se refieren a otra cosa”.

Julio Gonzalo, vicerrector de investigación de la UNED, también pudo comprobarlo. Le pidió una lista de poetas españolas del siglo XX, lo que hizo correctamente. Luego al decirle que se había equivocado en una (lo que no era cierto), ChatGPT lo admitió, se disculpó y se inventó sus fechas de nacimiento y muerte para encajar con lo que le señalan.

No es un secreto que ChatGPT se inventa cosas. En OpenAI lo admiten y dicen que hay mucha tarea aún por hacer. “ChatGPT a veces escribe respuestas plausibles pero incorrectas o sin sentido. Solucionar este problema es complicado, ya que (1) durante el entrenamiento, actualmente no hay una fuente de verdad; (2) entrenar al modelo para que sea más cauteloso hace que rechace preguntas que puede responder correctamente; y (3) el entrenamiento supervisado engaña al modelo porque la respuesta ideal depende de lo que sabe el modelo, en lugar de lo que sabe el demostrador humano”, señalan en su sitio web.

Los riesgos de ChatGPT para la desinformación

Esto podría ser un riesgo para quien tome a ChatGPT como algo más que un juego, algo que ha advertido Sam Altman, CEO de OpenAI en Twitter y también está por escrito en su web, que advierte del carácter experimental del sistema.

Guersenzvaig ve lo que llama “las alucinaciones” de ChatGPT como un fallo y un gran problema. “Los textos que genera son prima facie coherentes, y esto está muy logrado. La gramática tiene unas reglas y en ese sentido tiene un campo importante para jugar. Pero la otra cuestión que tiene el lenguaje es la aplicabilidad práctica. Que una frase sea coherente o gramaticalmente correcta no dice mucho del contenido de verdad que tiene esa frase, y ahí está el problema”, señala.

“Si sabes del tema lo puedes verificar pero si le pides algo sobre un tema que no conoces es muy difícil verificarlo por la coherencia con la que te responde. Ahí hay un peligro que no es propio de este sistema pero que lo agrava, que es la información falsa”. Para Guersenzvaig, “ChatGPT es una máquina de generar información falsa, y esto es un gran problema. Cuando hay mucha información sobre el tema, encuentra más, cuando hay poca es cuando empieza a descarriar”.

Lo cierto es que es un alivio que realmente no comprenda la intención de la pregunta y que simplemente se límite a generar una respuesta coherente pero carente en gran parte de los casos de validez.,

Ya que de otra forma podríamos hacer que nos proporcionase información sensible...Y peligrosa de manera rebuscada.

Como ayudarnos a crear un arma casera,ayudarnos a conseguir un veneno o fabricar un explosivo.

me dan asco los negros

Yo intenté hacer un exámen usando chatgpt y casi suspendo. Es más inútil que un peine para un calvo. Y la gente está engañada creyéndose que eso es inteligencia artificial. No es más que un bluf, un truco de prestidigitador para hacer creer al populacho lo que no es. No es confiable en absoluto. Y nunca lo va a ser. Pues se basa en asociaciones de datos y hechos. Y eso no es inteligencia.

entonces no sabes usarlo para nada jajaja

Tampoco es veraz en su información respecto a temas de derecho. Le solicité datos de sentencias sobre un tema y me dió numerosos roles de sentencias, los cuales eran todos falsos, no existían dichas sentencias o eran sobre materias distintas.

también cuando le preguntas por articulo, su base legal es inventada

Tampoco es precisa cuando uno le pide citas o párrafos (finales) de obras literarias muy conocidas (hagan la prueba con "El amor en los tiempos del cólera" de Gabo), menos cuando se le solicita las raíces de ecuaciones polinómicas simples (pídanle la respuesta de una cúbica por ejemplo), o problemas de física (movimiento parabólico, o el problema de llenado de tanques). La verdad es que hay todavía mucho pan por rebanar....!!!

Pero si supo responder cuánto es la mitad de uno.

El ombligo.

Le pedí a esta IA que me busque información de un tema de biología molecular y que me lo argumente con bibliografía. Como conozco del tema quería ver cómo funciona. Me dio un lindo discurso muy bien argumentado, pero cuando quise verificar las citas bibliográficas estas no existen. Le hice saber que me entregó información errónea:

- No puedo encontrar el articulo Plant Cell Reports, 30(10), 1857-1866 donde se publica la transformación genética de ...

Y esta fue su respuesta:

R: Lamento la confusión. Parece que hubo un error en mi respuesta anterior. No hay ningún artículo con el título "Development of a simple and efficient Agrobacterium-mediated transformation system for the......."

Fue un poco divertido, pero nada más.

Bueno, un amigo me la mostró y vi de la forma eficiente como respondía y le vi sentido pero como apenas la veía quise saber más de esto, para saber si es fiable. Mas que todo queria saber si es una forma de espiar a las personas o algo así, aún así me había parecido divertido. Pero es como los bot de ajedrez, podrán ser mejor que los humanos, pero no tienen el sentimiento solo está cumpliendo una programación pero nada supera al ser humano

Dejo un ejemplo en el que se desdice, pero de una forma exquisita y maravillosamente explicado.

Yo: ¿Es la gravedad una fuerza?

ChatGPT: Sí, la gravedad es una fuerza. Es la fuerza de atracción gravitatoria entre dos objetos con masa. La gravedad es la razón por la cual los objetos caen hacia el suelo y es la fuerza que mantiene a los planetas orbitando alrededor del sol. La gravedad es descrita por la teoría de la relatividad general de Einstein como una curvatura del espacio-tiempo causada por la masa y la energía en él.

Yo: Pero si es una curvatura del espacio-tiempo, no es una fuerza a distancia como la describió Newton.

ChatGPT: Tienes razón, la gravedad no es una fuerza a distancia como la descripción de la gravedad de Isaac Newton. Según la teoría de la relatividad general de Einstein, la gravedad no es una fuerza entre dos objetos, sino que es una consecuencia de la curvatura del espacio-tiempo causada por la masa y la energía en él. En otras palabras, los objetos no ejercen una fuerza gravitatoria uno sobre otro, sino que se mueven en línea recta en un espacio-tiempo curvo creado por la masa y la energía. Esta es una idea radicalmente diferente de la gravedad de Newton, pero ha sido confirmada por una gran cantidad de experimentos y observaciones.

Hola, Vosotros habeis encontrado la bibliografia que dice chatgpt sobre un tema?. No creeis que inventa libros no publicados?. ME pongo a buscar los libros que le pido sobre un tema con su año autor y editorial y no encuentro nada. Es posible que se lo este inventando?

Se inventa bibliografías, sí, también. He visto algunos casos y me han contado de otros, todo título, año, editorial. Es buena intentando ser creíble :)

Falla más que una escopeta de feria. Pese a todo, me encanta!

Fantástico artículo como siempre.

A mí me falla mucho el ChatGPT. Le pido que sinónimos de palabras y me da palabras que no tienen que ver, le pido que me haga una lista con palabras con todas las vocales como "Murciélago" y me las genera sin usar las cinco. Luego le digo que esa palabra no tenía las cinco y me terquea que sí. Le falta mucho, es una IA muy cuñada. Eso es lo que le da algo de realidad.

Gracias. Sí, es muy peligrosa en términos de quién la usa... Es muy avanzada en términos conversacionales, lo que es un éxito indiscutible, pero en cuestiones de veracidad no podemos "creerle".

me fío más de él que de vosotros

Le pedí a ChatGPT que me hiciera una frase con tres palabras y me la hizo con dos, se lo dije y entonces me hizo otra con dos nuevamente. Así varias veces. Otro día le dije que La Gioconda del Louvre es una réplica y que la auténtica está en una cámara secreta a lo que me dio la razón argumentando que así se protegía de la delincuencia. Para después hacerle mención a ello y comenzar a negarlo y que jamás dijo tal cosa. No es fiable hoy por hoy. Es una máquina. Y en estos momentos una máquina 'cuñada'.

En este sitio hay personas, que también se pueden equivocar y rectificar, aportan todo tipo de pruebas y se pueden verificar. Así que yo sí me fío más de Newtral que de ChatGPT, vamos, sin pensarlo.

Es importante tener en cuenta que ChatGPT es una herramienta de lenguaje natural generativa, lo que significa que está diseñada para generar texto en lenguaje natural a partir de un conjunto de patrones estadísticos, pero no para comprender el significado real de lo que está escribiendo. Esto significa que, aunque puede producir texto que parezca coherente y bien escrito, no tiene la capacidad de razonar ni de entender verdaderamente el lenguaje humano. Por lo tanto, no es una herramienta confiable para obtener datos veraces o para tomar decisiones importantes. Es importante ser críticos y verificar la veracidad de la información que se obtiene de cualquier fuente, incluyendo ChatGPT.

Intenté enviar un mensaje antes y ni se qué pasó; a ver,un poco flojo el artículo, listillos de Newtral, yo ya sabía todo lo que explicáis, solo hace falta leer un poco de documentación y saber por dónde van los tiros. Todos estos proyectos están en pañales todavía, deja que pasen 3 o 4 años y veremos qué decís entonces... Seguro que son más newtrales que vosotros.. :)

Pufff.. Un poco flojo el artículo, yo ya me sabía eso y más, solo hay que leer un poco la documentación pa ver cómo va el tema. Todo está en "pañales" todavía, listillos de Newtral, creo que aquí habéis patinado un poco. Saludos cordiales. ;)

Pues ha estado muy bien y no han dicho ningún mentira. Han hablado con un entendido del campo, con palabras de los propios desarrolladores. ¿Que propones para hacer un artículo más redondo?

Por lo menos la IA no deforma la información y la adapta a ninguna línea editorial.

Quiero conocer este robot

Osea, igual de fiables que vosotros, newtral.

Aclarado.

jajajajaja, Angel, lo has bordado, jajajaja. Creo que el Gobierno de España podría ser un claro ejemplo de Chat IA...

Y todos esos “problemas u objeciones”… ¿en qué se diferencian de la mayoría de los medios de comunicación y de todas las RRSS?

En que los crea una máquina